En España sólo pueden votar los mayores de edad, es decir, los mayores de 18 años. ¿Qué pasaría si en las elecciones estatales y autonómicas pudieran votar los menores de edad? Nada cambiaría en los resultados para los dos grandes partidos. Se han presentado fotos de políticos tanto a adultos como a niños. Las fotos eran de políticos franceses, desconocidos tanto para los adultos como para los niños. Los adultos tenían que elegir al político más competente. Los niños tenían que elegir el mejor capitán de un «hipotético» barco para un juego por ordenador. Sorprendentemente, los resultados de adultos y niños coinciden entre sí y con los resultados electorales de las elecciones a las que se han presentado dichos políticos. Así lo han demostrado los suizos John Antonakis y Olaf Dalgas de la Universidad de Lausana en el estudio publicado hoy en Science, «Predicting Elections: Child’s Play!«). ¡A qué cosas se dedican los suizos mientras contemplan las bellas vista del lago Lemán! Irles bien, les ha ido bien, ya que lo han publicado en Science.

En España sólo pueden votar los mayores de edad, es decir, los mayores de 18 años. ¿Qué pasaría si en las elecciones estatales y autonómicas pudieran votar los menores de edad? Nada cambiaría en los resultados para los dos grandes partidos. Se han presentado fotos de políticos tanto a adultos como a niños. Las fotos eran de políticos franceses, desconocidos tanto para los adultos como para los niños. Los adultos tenían que elegir al político más competente. Los niños tenían que elegir el mejor capitán de un «hipotético» barco para un juego por ordenador. Sorprendentemente, los resultados de adultos y niños coinciden entre sí y con los resultados electorales de las elecciones a las que se han presentado dichos políticos. Así lo han demostrado los suizos John Antonakis y Olaf Dalgas de la Universidad de Lausana en el estudio publicado hoy en Science, «Predicting Elections: Child’s Play!«). ¡A qué cosas se dedican los suizos mientras contemplan las bellas vista del lago Lemán! Irles bien, les ha ido bien, ya que lo han publicado en Science.

En «La República», Platón afirma que «… Imagínese un barco en el que hay un capitán que es más alto y más fuerte que cualquiera de la tripulación, pero es un poco sordo, tiene problemas de visión y poco conocimiento de navegación.» Platón afirma que la tripulación (es decir, los votantes) es incapaz de elegir un capitán competente (es decir, un gobernante), porque les engañan las apariencias. Platón utiliza esta parábola para sugerir que los votantes carecen de facultades y conocimiento racional a la hora de elegir a sus gobernantes.

En la democracia ideal, los políticos son elegidos por su competencia. Pero la realidad está muy alejada del caso ideal. ¿Cómo si no han sido presidentes Reagan o los Bush? O en el caso andaluz, Chaves, o en el venezolano, Chávez. Factores como la apariencia física y los rasgos faciales son mucho más importantes que la competencia (inteligencia y capacidad de liderazgo). En la vida diaria estamos acostumbrados a «valorar» a una persona por su aspecto físico y aplicamos la misma regla en las elecciones a políticos. Sin embargo, está demostrado que la inteligencia de los adultos no se puede predecir a partir de su apariencia física. De hecho, existe una gran variación en la competencia de los políticos. ¿Votamos los adultos en gran parte como votaría un niño?

En un experimento, 684 adultos suizos tuvieron que elegir entre pares fotos de políticos franceses (elegidos entre 57 de los que se presentaron a las elecciones parlamentarias en 2002) el más competente como gobernante. El 72% de las veces eligieron al que realmente ganó las elecciones. En un segundo experimento, 841 menores, de los cuales 681 eran niños entre 5 y 13 años, jugaron a un juego por ordenador en el que tenían que viajar en barco desde Troya a Ithaca. Debían elegir un capitán para su barco entre los mismos pares de fotos de políticos franceses que se ofrecieron a los adultos. El 71% de las veces eligieron al que realmente ganó las elecciones. El resultado no cambia si se separan los menores en dos tramos de edad, por un lado los 160 mayores de 13 y por otro el resto.

Un estudio de la correlación entre ambos resultados estadístico muestra que es imposible saber si un resultado electoral ha sido votado sólo por adultos, sólo por niños, o por adultos y niños.

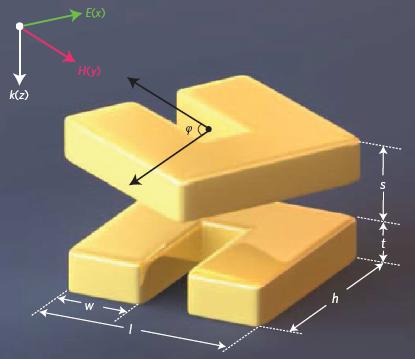

No sé a vosotros, pero a mí los avances en fotónica de metamateriales me apabullan. Que se pueda curvar la luz a gusto o lograr la invisibilidad de un objeto me resulta casi mágico. Pero los avances en nanofotónica de metamateriales son más sorprendentes aún. Se acaba de publicar en Nature Photonics un nuevo concepto, los estereometamateriales, basados en apilar tridimensionalmente nanounidades que permiten configurar las propiedades ópticas del metamaterial resultante. ¡Increíble! El artículo técnico es Na Liu, Hui Liu, Shining Zhu, Harald Giessen, «

No sé a vosotros, pero a mí los avances en fotónica de metamateriales me apabullan. Que se pueda curvar la luz a gusto o lograr la invisibilidad de un objeto me resulta casi mágico. Pero los avances en nanofotónica de metamateriales son más sorprendentes aún. Se acaba de publicar en Nature Photonics un nuevo concepto, los estereometamateriales, basados en apilar tridimensionalmente nanounidades que permiten configurar las propiedades ópticas del metamaterial resultante. ¡Increíble! El artículo técnico es Na Liu, Hui Liu, Shining Zhu, Harald Giessen, «

El «mar abierto» (la zona pelágica del océano) nos reserva muchos misterios aún por desvelar. Esta región del océano donde el agua no cubre la plataforma continental está repleta de organismos llamados pelágicos. Se estima que es la región de mayor biodiversidad de la Tierra. La zona más estudiada es la epipelágica (desde la superficie hasta los 200 m.) donde hay suficiente luz para que las plantas realicen la fotosíntesis y donde se concentran la mayoría de los organismos pelágicos conocidos. La zona mesopelágica (desde los 200 m. hasta los 1000 m.) es una zona de penumbra donde penetra un poco de luz, pero es insuficiente para la fotosíntesis. Una región prácticamente desconocida que el grupo de investigación de Bruce Robison del Instituto de Investigación del Acuario de la Bahía de Monterrey (Monterey Bay Aquarium Research Institute o MBARI) está estudiando desde hace 10 años con cámaras submarinas montadas en pequeños submarinos controlados por control remoto. Las sorpresas que han encontrado son increíbles.

El «mar abierto» (la zona pelágica del océano) nos reserva muchos misterios aún por desvelar. Esta región del océano donde el agua no cubre la plataforma continental está repleta de organismos llamados pelágicos. Se estima que es la región de mayor biodiversidad de la Tierra. La zona más estudiada es la epipelágica (desde la superficie hasta los 200 m.) donde hay suficiente luz para que las plantas realicen la fotosíntesis y donde se concentran la mayoría de los organismos pelágicos conocidos. La zona mesopelágica (desde los 200 m. hasta los 1000 m.) es una zona de penumbra donde penetra un poco de luz, pero es insuficiente para la fotosíntesis. Una región prácticamente desconocida que el grupo de investigación de Bruce Robison del Instituto de Investigación del Acuario de la Bahía de Monterrey (Monterey Bay Aquarium Research Institute o MBARI) está estudiando desde hace 10 años con cámaras submarinas montadas en pequeños submarinos controlados por control remoto. Las sorpresas que han encontrado son increíbles. La noticia ha aparecido en muchos medios, yo destacaría a Tami Freeman «

La noticia ha aparecido en muchos medios, yo destacaría a Tami Freeman « Disculpas: Carl, si lees esto, perdón por la ironía, ¡es envidia! Ya me hubiera gustado a mí que se me ocurriera esta idea. Lo mismo hasta te citan tanto como a Hirsch.

Disculpas: Carl, si lees esto, perdón por la ironía, ¡es envidia! Ya me hubiera gustado a mí que se me ocurriera esta idea. Lo mismo hasta te citan tanto como a Hirsch.